在具身智能成为全球科技竞争高地的今天,高质量3D数据已成为推动机器人从“感知智能”迈向“行动智能”的战略性资源。过去十年,3D数据领域由欧美主导的ModelNet、ShapeNet等静态数据集奠定基础,Objaverse-XL更是将3D资产规模推向百万级别,然而,这些数据仍难以支撑机器人在真实物理环境中的复杂操作需求。

近年来,尽管PartNet-Mobility、SAPIEN等数据集尝试引入“可动性”概念,推动3D数据从静态走向动态,但仍受限于数据规模、动作一致性与物理精度,无法满足机器人对复杂交互行为的学习需求。在这一背景下,高质量、结构化、具备物理约束的铰接物体数据(Articulated Objects)成为全球研发机构共同追逐的关键突破口。

作为天娱数科旗下专注空间智能的MaaS平台,Behavision Pro致力于构建面向具身智能时代的数据基座。平台目前已累计超过150万条3D数据、65万条多模态数据,并构建了涵盖丰富物理属性的3D铰接数据集。该数据集自发布以来,凭借其在数据一致性、物理精度与行为可解释性方面的综合优势,迅速获得全球开发者认可,持续位列HuggingFace平台3D铰接数据集下载前列,并被广泛应用于视觉—语言—动作模型以及强化学习、模仿学习等核心任务中。

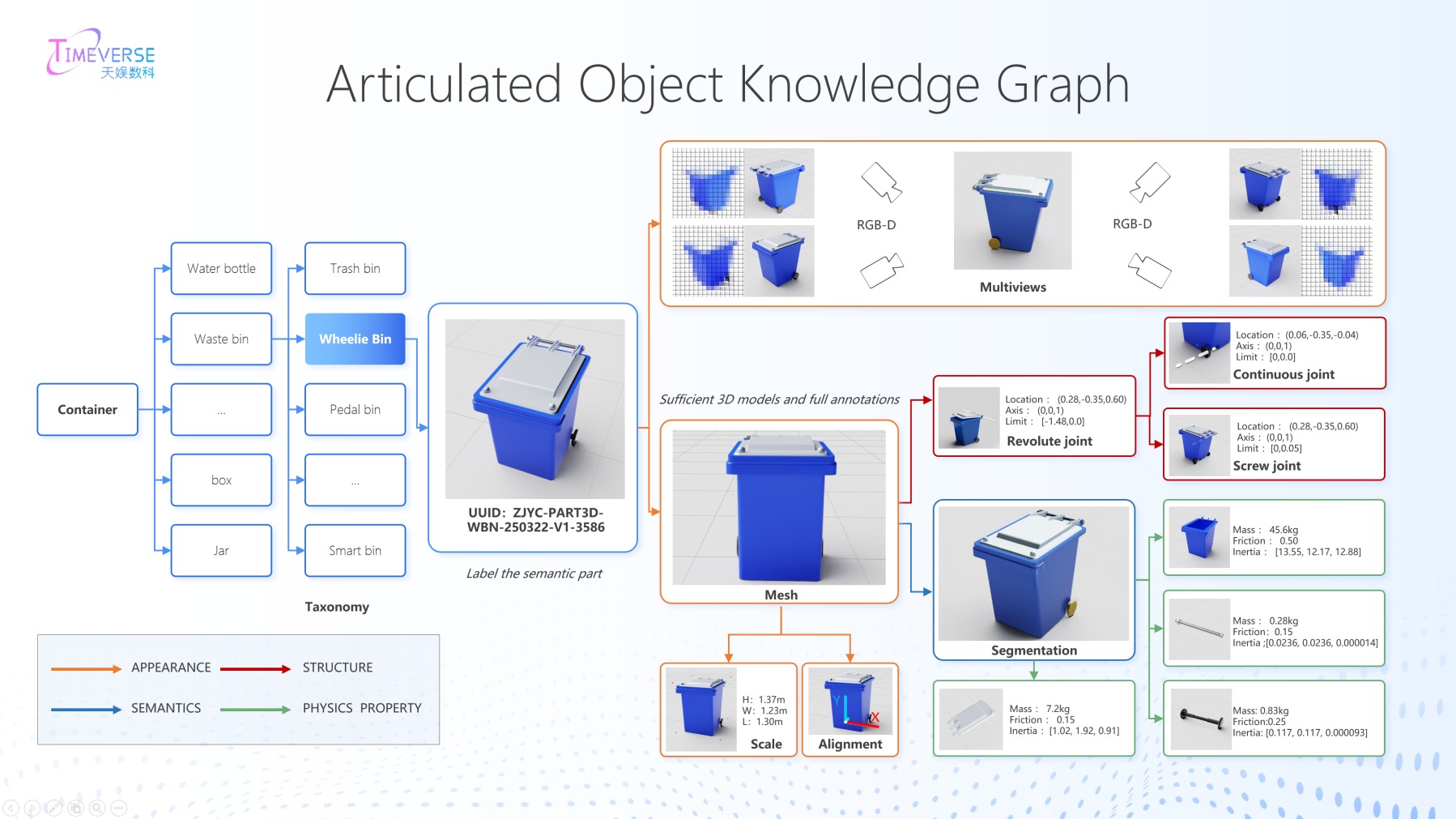

区别于传统3D数据仅描述物体“是什么”的局限,Behavision 3D铰接数据集系统性定义了“如何操作对象”的行为逻辑,构建了从感知到行为的完整表达框架。其核心能力体现在四个层面:

·外观层:提供RGB、深度、法线等多模态渲染,为视觉感知学习提供支撑;

·结构层:覆盖旋转、滑动等多种关节类型,精准描述物体运动逻辑;

·语义层:标注可交互部件与动作方向,直接引导机器人策略生成;

·物理层:定义质量、惯量、摩擦等动力学参数,确保仿真环境符合真实物理规律。

通过这一高维结构化体系,Behavision 3D铰接数据集成功搭建起连接“视觉识别”与“行为生成”的桥梁,有效支撑Real2Sim2Real闭环学习——以真实数据校准仿真环境,再通过仿真策略反哺现实应用,显著缩小“仿真—现实差距”,推动机器人实现从感知理解到任务执行的全面跃迁。

具身智能的每一次跃迁,本质都是数据能力的跃迁。从静态几何到动态交互,从单一感知到全链路行为生成,3D数据正从“基础资源”升级为“核心竞争力”。天娱数科Behavision平台通过结构化设计与物理真实性突破,为当前全球铰接数据稀缺的行业瓶颈提供了切实可行的解决方案。

未来,天娱数科将持续加大对行为导向3D数据资产的投入,不断优化和拓展数据集内容,构建更高标准、可扩展的仿真数据体系,为通用具身智能体的研发提供系统化、结构化的物理世界数据支撑。公司始终秉持开放共建的理念,期待与全球科研机构及开发者携手,共同推动行业数据基础设施的升级与互通,加速具身智能时代的全面到来。