AI大模型浪潮翻涌,正催生出一系列连锁反应。

一方面,AI推理飞速演进,以“OpenClaw(龙虾)”为代表的AI Agent超级应用快速崛起,正掀起一场席卷全球的技术竞赛。

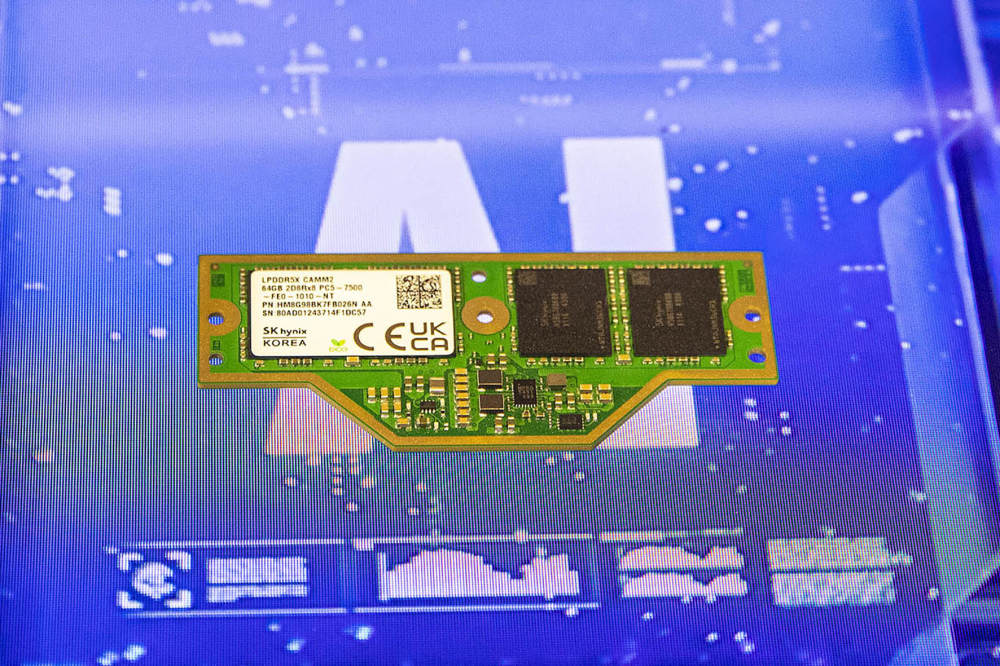

另一方面,曾经被视作AI算力基础设施“配角”的存储芯片,正逐渐走到舞台中央,成为支撑大模型训练与推理、端云协同交互的核心底座,这已经不仅是HBM(高带宽内存)的主场,全球正掀起一场争夺先进“存力”的新战役。

在此背景下,存储行业正经历一场“十年未见”的波动行情。供需紧张、技术迭代、架构革新三重因素交织,一场关乎生存与增长的产业竞赛悄然打响。

存储走到中央

存储产业全面走向全球AI舞台中央,来自于头部大厂和AI应用的共同催化。

存力一直以来伴随算力的需求而生,在早期,英伟达GPU芯片对HBM(DRAM内存芯片的一种)有旺盛需求。而彼时存储产业正面临严峻的下行周期,于是头部厂商倾向于将产能转向具备高利润空间的HBM产品,相比之下,则放缓了NAND Flash芯片的资本开支。

但随着英伟达新一代芯片推出,对NAND Flash芯片开始有更多需求。当前全球产能情况已经无法及时满足这些新增需求。

这本质上是伴随AI广泛落地,而推动的技术路线快速演化。

在AI推理应用阶段,往往涉及多轮问答交互,而大模型在后台会随时进行准备,该过程中会令KV Cache(键值缓存)呈现指数级增加,因此需要相匹配的存力。

大普微董事长杨亚飞分析道,AI在推理阶段对存储提出了全新要求。有业界做过预估,每128K token约合需要61GB存储量作为匹配,那么当前日均万亿级别的token处理量,对存储形成海量需求。相比之下,HBM价格昂贵且容量有限,HDD(机械硬盘)又无法满足随机读写的性能要求,而SSD凭借低延时、高容量等特征,因此被高度重视,当前市场中有大量SSD需求空白需要填补。

此外,杨亚飞续称,当前正处在AI推理大爆发时期,以“龙虾”为代表的Agent超级应用正掀起新浪潮。这令数据来源发生结构性变化:从过去由人产生,到逐渐由机器产生。此前曾有观点认为只有HBM更受益于AI浪潮,但与SSD无关,如今,AI推理和应用的进一步爆发,显然正让更多存储品类受益。

另据花旗研究,一台完整的新一代英伟达Vera Rubin服务器配备72块GPU。基于该架构,每块GPU需对应16TB的SSD用于上下文内存存储(ICMS)。因此,单台服务器就需要额外搭载高达1152TB(即1.152PB)的NAND闪存。

倘若从积极情况分析,花旗研究认为,若2027年部署10万台服务器,有望带来约1.152亿TB增量需求,相当于全球NAND存储市场总需求的9.3%。

慧荣科技总经理苟嘉章也指出,英伟达推出CMX上下文存储平台,让存储的地位变得愈发重要,导致架构从data storage进入compute storage阶段。“对存储业是很好的消息,这意味着有更多能力可以释放。”他续称,慧荣科技也在布局PCIe Gen6等下一代技术,强调性能与功耗平衡,助力客户在AI推理与训练场景中实现更高效的数据调度。

同时,在技术和供应两个条件共同驱动下,本轮存储周期被业内称为“十年未见”,其持续性与价格走势备受关注。德明利企业级存储产品管理部总监陈进葵分析认为,原厂产能扩张投资规模大、周期长,当前产能释放仍较为谨慎,而市场需求尤其是AI领域的爆发,正在推动存储需求结构发生根本性变化。

他进一步分析道,从行业获取的信息显示,自2025年下半年开始,海外云服务厂商开始与原厂锁定长期产能,导致存储芯片供应向数据中心倾斜;而大模型应用的持续爆发,带来KV Cache(键值缓存)爆发式增长,这直接导向存储需求爆发。这意味着,目前供给端和需求端都指向存储行业处在景气上升趋势中。

“德明利在早期做了较为长期的供应链规划,所以有相应长期产能保障。”他指出,在产品组合方面,公司在企业类、嵌入式、工控和消费类等多个领域均有存储产品布局,覆盖高中低端不同定位。希望通过持续优化产品结构,缓解行业价格波动带来的影响,同时推进在高端存储产品的开发节奏,以期进一步推进高价值应用的落地。

面对当前存储芯片供不应求的局面,杨亚飞指出,粗略预估当前仅能满足50%的市场需求,但每一次供应链危机都会倒逼技术创新。大普微通过透明压缩等技术,极大节省成本,这不仅有望缓解供应紧张,也将持续降低存储成本。

此前谷歌发表TurboQuant技术也是基于此类逻辑。长此以往,他认为存储成本的下降将刺激更大规模的应用落地,类似于手机从“大哥大”走向“千元机”带动移动互联网爆发一样,推理应用的普及也将迎来更广阔的未来。

“龙虾”激发需求

从整体趋势看,AI大模型的发展从过去以文本为主,到如今视频生成类应用涌现,显示出当前正处在AI技术大爆发的时期。苟嘉章提到,存储产业如何用更高效的方式进行存储、存算更好协同都是其中核心要义。

他续称,例如谷歌提出的Turbo Quant技术有助于提升存储效率,但KV Cache本质上是临时性存储,与Agentic AI的个性化需求密切相关。他认为,存储效率的提升对整个行业是利好,未来不排除会涌现更多新技术,这并不会削弱存储的重要性。

联芸科技存储事业部产品副总经理金烨也分析,以“龙虾”为代表的AI Agent应用落地过程中,当前仍面临算力成本高企的问题,业界也在积极应对。随着技术优化和成本下降,AI应用加速普及,带动整体存储市场容量扩张。

当然,进入Agent元年,各类应用落地对存储产业链的技术能力提出更多要求。

得一微电子(YEESTOR)首席市场官罗挺分析,过去存储芯片的核心竞争力在于容量,如今,随着“OpenClaw(龙虾)”等AI智能体应用的快速演进,存储创新的重心转向以高性能、智能化及高效数据处理为核心的“AI存力”综合提升。

“大模型的应用落地需要更多上下文支持,如何优化数据处理效率、提升系统整体性能,这成为存力创新的关键点。”他进一步分析道,AI大模型的出现,需要不同类型的算力与存力芯片协同工作,得一微着眼于推进存力更好支撑端云协同。

据悉,从2025年开始,得一微围绕存储控制、存算互联、存算一体三大技术路径,以提升AI系统整体运行效率。整体看,得一微面对AI时代的存力需求,聚焦两大创新方向:一是高存力,即通过存力主控芯片提高LLM推理的性能和效率,让每比特数据创造更多智能;二是高可靠,以满足手机、汽车、工业等场景的严苛要求。

据联芸科技董事长方小玲分析,面对推理场景带来的新挑战,如KV Cache带来的随机读写与带宽压力,传统主控架构已难以胜任。联芸科技通过引入KV加速引擎、预测性预取、无感垃圾回收等核心技术,显著提升推理场景下的吞吐量与稳定性,并实现低延迟保障。

金烨介绍,联芸已在企业级市场布局PCIe 5.0产品,具备512TB的容量支持能力,并在功耗控制方面具备优势。公司也在推进QLC NAND的研发,这是未来大容量存储的重要方向,同时在TLC与QLC之间实现灵活支持,以满足不同应用场景的需求。

特纳飞系统和产品副总裁赵亮指出,本轮端侧AI发展过程中要求模型在本地运行并实现实时Agent交互,这对存储提出四大新要求:极高的响应速度(毫秒级响应)和极低延迟、低功耗、高带宽和大容量(PCIe 5.0/NVMe 2.0成标配)以及高稳定性与可靠性。

特纳飞从进入消费级SSD市场时,便专注于DRAM-less控制器,截至今年一季度,公司自研的新一代主控存储芯片可以在无外置DRAM的情况下实现高性能、低功耗;同时在固件层面,优化AI模型加载/推理路径,目的就是适配端侧大模型与Agent场景。

赵亮透露,公司还在与终端厂商联合定义端侧AI存储方案,提前适配下一代AI PC和AI手机。由此,公司已经实现从存储主控供应商升级为端侧AI存储方案商。

“龙虾热”表面是AI应用层的狂欢,实则是对AI整体基础设施底座的一次大考。从HBM的一枝独秀,到SSD、主控芯片、存算架构的全线爆发,存储行业正经历从“配角”到“底座”的身份跃迁。

AI推理爆发带来的海量存力需求、GPU架构革新推动的存算协同变革、端云一体化对性能与功耗的极致要求,共同将存储行业推向产业变革的核心地带。尽管短期内存储芯片短缺加剧、行业周期波动与技术挑战并存,但每一次供需紧张都在倒逼技术创新,并以此打开新的增长空间。