具身数据集的赛道越来越火热。

近期,戴盟机器人联合包括 Google DeepMind、中国移动、新加坡国立大学、香港科技大学、北京大学、清华大学等多家知名企业和学术机构,发布全球最大规模含触觉全模态物理世界数据集Daimon Infinity。

无独有偶,今年一季度,具身数据赛道还有智元机器人开源“agibot world 2026”数据集,聚焦真实场景数据,覆盖商业空间、家居等通用场景,提供结构化、精细标注的数据;宇树科技发布“unifolm-wbt-dataset”,主打全身遥操作真机数据。

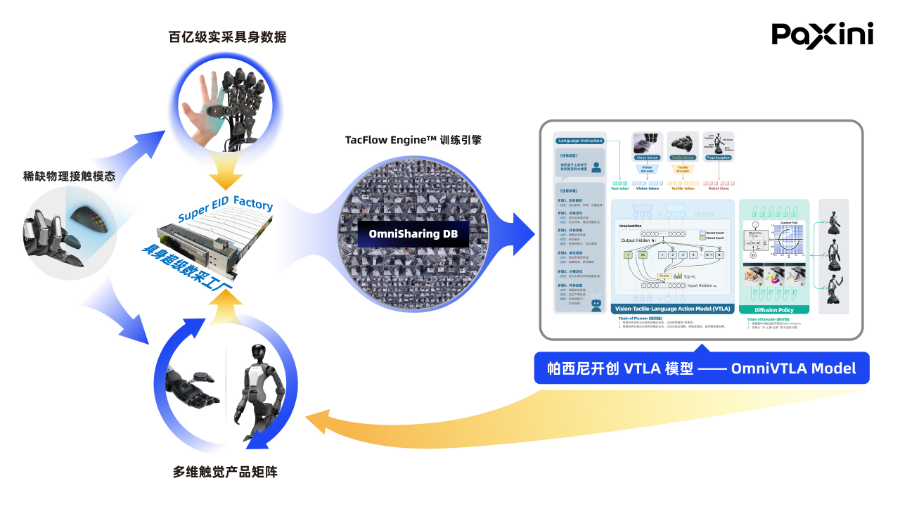

此外,帕西尼也于今年年初在江苏宿迁、湖北武汉、四川自贡、江西赣州再建4座超级数据采集工厂,与此前在天津已落成的数据采集工厂,共同构建起全球规模量级的具身智能数据采集工厂集群。

(图/帕西尼的具身超级数采工厂工作链路)

多家具身智能机器人企业集中打通数据管道,源于数据已成为具身智能从实验室走向真实世界必须跨越的隘口。

过去具身数据采集依赖于封闭的数据采集厂,不仅成本高,而且场景单一,过于标准化,导致数据高度重复,无法支撑具身模型在现实复杂环境中稳定运行。行业数据显示,具身智能需要数百PB级物理交互数据,当前存量缺口超99%。

“目前海内外公司对具身数据的渴求程度很高,因为机器人本体能力的落地前提是机器人要具备经验值,这个经验值就在于数据,数据成为机器人工作的底层能力。”帕西尼CEO许晋诚向21世纪经济报道记者表示,机器人本体质量虽在提升,但泛化性不足仍是阻碍机器人进入千行百业的“最后一公里”,让模型理解物理规律、掌握灵巧操作,海量且真实的带物理模态的数据是行业“解药”。

以触觉为例,具身智能过去依赖于视觉感知,但其可能因遮挡、光线不足而失灵。与视觉的远距离感知不同,触觉为机器人提供了最直接的物理反馈,有效弥补了视觉的盲区和错觉。曾经被视为高端选配的触觉,如今已逐渐成为具身智能的必选项,只有实现视觉与触觉的深度协同,机器人才能在复杂的物理环境中完成精准、稳定的操作。

戴盟联手共建的Daimon Infinity数据集就覆盖了接触形变、滑移趋势、接触状态及物体纹理、软硬、材质等在内的十多种触觉模态,捕捉真实世界物理信息,完整还原物理交互过程。经验证,该数据集在用于模型预训练时,只需要十分之一的数据量,即可在轴孔装配、污痕擦拭、果蔬切削等多项精细操作任务中大幅提升成功率,训练效率提升10倍。

戴盟机器人有关负责人向21世纪经济报道记者表示,过去具身数据普遍依赖仿真合成或封闭式工厂采集,难以满足泛化能力需求,此次戴盟构建了全球最大规模的外发式数据采集网络,通过自研的轻量化、便携式采集设备,让采集工作走出数采厂,进入户外、家庭、工厂等环境复杂、非标准化的场景,采集真实环境中的真实操作,将真实的人类经验转化为机器人提升泛化能力的教材。

据了解,戴盟还免费开源10000小时数据。上述负责人表示,一方面,高质量数据的大规模共享,避免各家企业在数据采集上重复造“轮子”;另一方面,这也是一次行业内对于含触觉数据的规模化探索,推动建立统一的技术标准。

业内除了数据开源,帕西尼近期还推出了全球首个百亿级规模全模态具身智能数据云商城。

“数据即便有了,但数据跟模型之间的链接也就是工具链也很重要,数据最终要解决的是下游应用的打通能力,目前公司的百亿级数据采集规模,可以满足至少30种行业应用需求,后续也会持续增强数据采集能力,帮助大家快速打通从数据量、数据使用到数据模态,从而提升整体模型能力。”许晋诚表示。

“通过高质量数据的大规模开源共享,将为具身智能打造从实验室走向产业的高质量数据底座,可赋能整机与模型厂商快速验证技术路线、降低研发成本,大幅缩短具身智能实现精细操作、提供泛化能力、走向商业化落地的周期,加速具身智能机器人在现实落地。”戴盟机器人有关负责人表示。