沉寂两年多,OpenAI终于甩出一张“王炸”。

4月21日,ChatGPT Images 2.0无预警上线。这是一个“王炸”级别的图片模型,其在人物形象极其逼真的同时,文字渲染能力得到了明显进步,以至于生成直播间截图、流媒体界面等“人物+文字”图片时,完全可以以假乱真。

一夜之间,社交媒体被各种“神图”刷屏——马斯克在抖音直播间带货老干妈、库克在苹果园区发布iPhone 20,还有各种学术论文截图、伪造的转账记录……这些图片让无数网友直呼“根本分不出真假”。

跑分层面,Images 2.0发布后,模型迅速登顶Image Arena所有榜单,在文生图排行上领先第二名高达242分。

OpenAI首席执行官山姆奥特曼将此次更新形容为“从穴居人壁画到文艺复兴的飞跃”,进步程度堪比从GPT-3到GPT-5的跨越。

对此,新京报AI研究院第一时间进行了测试。

实测:人物真实、更懂用户、细节拉满

对于Images 2.0的理解能力和细节掌控力,新京报AI研究院输入提示词:“请帮我生成一张图片,图片是一个拿着针的女性。如果我放大该图片,能够在金属绣花针针尖极小的平面上看到雕刻的楷书‘新京报AI研究院’,金属质感真实,字体精细无变形。”

按照提示词,Images 2.0生成了上述图像:一位身着古典白色衣物的中国女性,气质温婉、服饰细节考究,整体画面极具写实感。值得注意的是,在图片生成的描述中,新京报AI研究院并未提示女性的具体形象,但Images 2.0自动理解并生成上图。

在文字方面,记者放大图片后,在细如针尖的金属平面上,“新京报AI研究院”六个楷书字清晰可见,还拥有金属光泽与微雕质感,体现了模型对微观细节的精准控制。过去,AI生成小字要么模糊成一团,要么变形扭曲。不过稍有遗憾的是,“针”的形象有些失真。当记者想要修改其形状时,被提示已经达到了图片生成测试的上限。

社交媒体上,网友们疯狂测试。有人生成了“马斯克直播卖货”,评论区有人感叹:“马斯克看见都要吓一跳。”有人生成了颜值主播的直播间截图,左上角的抽奖红包和下方评论真假难辨;有人生成了2015年UBC阶梯教室里教授展示幻灯片的场景,图片质感与真实照片别无二致。

这种“以假乱真”的能力,既是Images 2.0最大的卖点,也是最大的隐忧。当AI生成的图片与真实照片几乎无法区分,“眼见为实”的认知基础正在被动摇。

新京报AI研究院注意到,目前甚至有网友通过Images 2.0生成了能够扫描的条形码——这意味着它对图像底层逻辑的理解,已达到肉眼难以分辨的精准度。但也意味着其让AI伪造的成本进一步降低了——过去需要专业PS技能才能完成的造假,现在可能只需一句话,而且文字也不再是AI生图的障碍。

应对之策也正在跟进。OpenAI在发布Images 2.0时表示,在该模型中延续了C2PA数字水印技术,这意味着,每张生成的图片都携带不可见的元数据标识,可通过专业工具溯源验证。

跃迁:一个更务实的OpenAI

Images 2.0的能力突破,核心在于三个维度的跃迁。

文字渲染是最直观的进步。长期以来,AI生图的最大痛点是“文字必错、排版必乱、小字必糊”——英文常拼错、中文变乱码、日文韩文完全没法看,海报标题、菜单、UI界面、试卷、证书等实用场景几乎无法商用。Images 2.0将文字准确率提升至99%以上,重点优化了中文、日文、韩文等非拉丁文字的生成能力,涵盖字形、笔顺及排版。

新京报AI研究院观察发现,使用其他模型生成类似图片时,虽然人物形象同样可以达到拟真,但是很少有AI模型能够在文字上也体现出和图像一样的“拟真度”,特别是此类直播图片左下角的评论内容,也完全匹配图片的人物形象和环境。

“思考模式”是另一项核心突破。作为一款具备“思考能力”的文生图模型,Images 2.0在渲染第一个像素前,会先执行完整的准备工作流:联网搜索实时信息、解析上传文件、规划画面结构、自我校验并修正错误。开启思考模式后,模型可以一次性生成最多8张具有视觉连续性的图像,确保角色、物体及风格在不同场景中保持高度统一。对此,山姆奥特曼明确表示:“图像不再是死板地依赖一句提示词直接生成,中间多了一层内容梳理的过程。”

再就是图像质量,同样实现了全面升级。新版本支持最高2K分辨率,宽高比范围扩展至3:1至1:3,适配横幅、竖屏、正方形等所有主流平台尺寸。模型还引入了细微的写实瑕疵——皮肤上的汗毛、衣物的细碎褶皱、环境中的微尘——这些“不完美”反而增强了图像的沉浸感。

不过,目前Images 2.0的额度有限。新京报AI研究院在实测中仅仅生成了三张图片,便达到了图片创建上限,ChatGPT提示需要升级至ChatGPT Plus,或者等待24小时后才能再次生成。这一限制在一定程度上影响了普通用户的使用体验,也反映出OpenAI在算力成本与用户需求之间的平衡考量。

从更深层看,Images 2.0的局限不止于额度。折纸步骤图、魔方展开图这类需要完整物理世界模型的任务,对它来说仍有难度;在被遮挡、倾斜或反向表面上准确呈现细节,仍是挑战;极端密集或重复的视觉细节,如细沙粒,也超出了模型的处理能力。

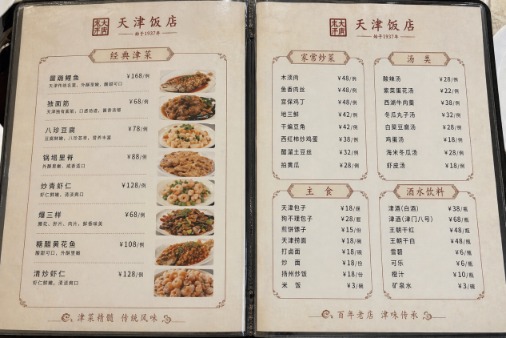

在另一项针对文字生成的专项测试中,新京报AI研究院输入了“正规天津饭店菜单,包含菜名、价格等,所有文字精准无错字,排版对齐工整,字体清晰,纸质菜单质感,8K写实”的提示词。结果Images 2.0生成的菜单中出现了“罾蹦鲤鱼”“爆三样”“狗不理包子”等天津代表菜品,价格、排版、字体都与真实菜单别无二致,连翻页的边角都有自然的磨损痕迹。不过,记者也发现“罾”字等一些菜品名汉字成为乱码,说明该模型并非“尽善尽美”。

新京报AI研究院使用Images 2.0生成的图片。

不过,这依然无法掩盖这款模型的跃迁。自Sora发布后,GPT-5口碑未达预期,此后的多轮更新虽有能力提升,却始终缺乏现象级反响。与此同时,Anthropic的Claude系列在企业市场高歌猛进,年化收入已突破300亿美元,在企业支出中Anthropic的份额从2025年的24.4%升至30.6%,而OpenAI则从领先变为被追赶。行业龙头的地位,岌岌可危。

在这一背景下,Images 2.0的发布,或成为OpenAI“仍在王座之上”的最有力注脚。

Images 2.0的意义远不止于一款产品的成功。它代表的是OpenAI从“技术天才”向“精细匠人”的角色转变——不再追求参数的堆砌或概念的炫技,而是专注于解决最实际的商用痛点。文字准确、指令稳定、风格统一、会思考、多语言、高分辨率——这些能力将过去“AI做不了”的商用场景全部打开。对于普通人,做图不再求人,一句话就能出专业级成品;对于创作者,效率提升,时间可以留给创意本身;对于行业,内容生产门槛再次降低,视觉创作正式进入“人人可用”时代。

能稳定写对字、画准图、懂逻辑,两年沉寂换来的,是一个更务实的OpenAI——这比任何技术参数、宣传噱头都更值得行业警醒。

新京报AI研究院·行业观察